2026年3月13日国内8家主流 AI Coding Plan 深度对比分析报告

2026年国内主流 AI Coding Plan 深度对比分析报告

采集时间:2026年3月13日

报告范围:火山引擎、百度千帆、讯飞星辰、MiniMax、阿里云百炼、腾讯云、智谱GLM、Kimi Code

采集时间:2026年3月13日

报告范围:火山引擎、百度千帆、讯飞星辰、MiniMax、阿里云百炼、腾讯云、智谱GLM、Kimi Code

在新版本的OpenClaw 2026.3.2中,官方对安全权限做了调整,在openclaw.json这个配置文件中,默认的tools->profile是messaging

1 | "tools": { |

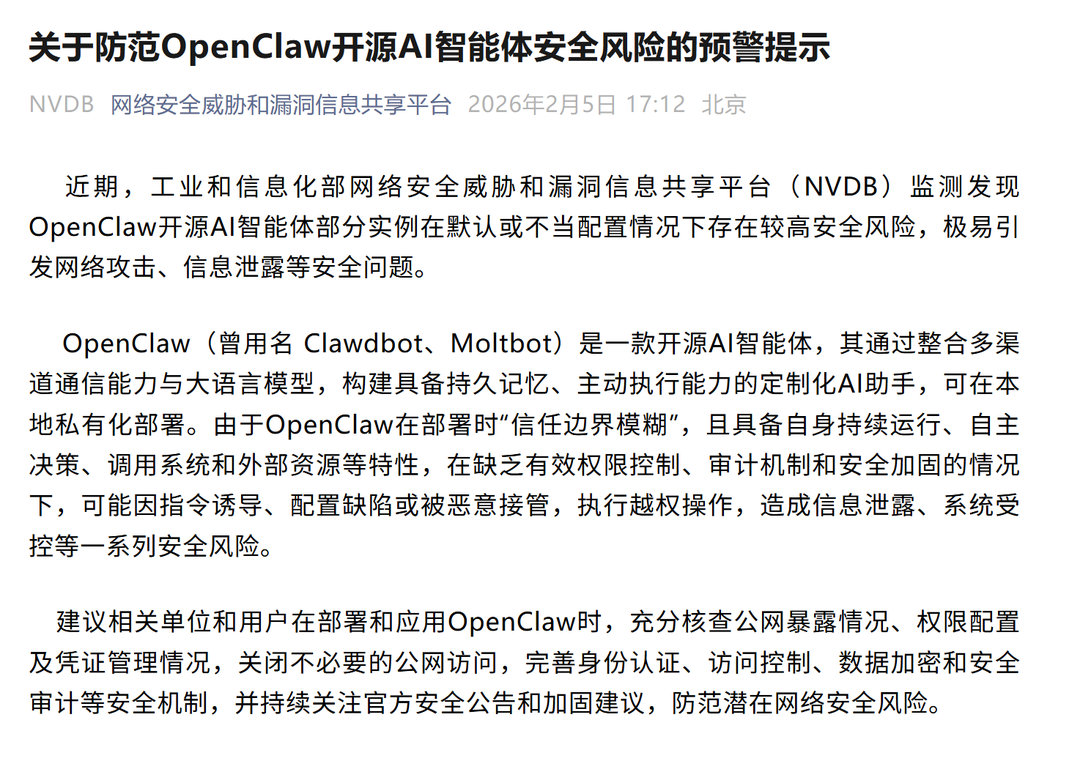

这是一个深思熟虑的安全权衡,新用户可能没有意识到让 AI 执行系统命令的潜在风险,因此默认限制为安全的聊天功能。如果你了解风险并希望使用完整功能,需要显式启用。最近,工信部提示OpenClaw开源AI智能体安全隐患,所以,在玩的时候,也要注意信息。

OpenClaw打通了飞书、企业微信、Telegram 等二十多个平台,在国内很多人都喜欢用OpenClaw去接飞书,这还是得去注册个飞书的账号,下载个飞书的App,我平时QQ用得多一点,所以,这里就先试试QQ中的效果怎么样,它支持Markdown、图片、语音、文件等多媒体消息收发,手机端QQ、桌面端QQ均可使用。

最近 OpenClaw 挺火的,网上各种玩法都有。我也想试试看,看看到底怎么样。为此还专门买了台 8H16G5M 的服务器,平时早餐连鸡蛋都舍不得吃,这次算是下血本了。

三天前更新了 2.1.51 和 2.1.52,两天前更新了 2.1.53、2.1.55、2.1.56、2.1.58,昨天更新了 2.1.59,今天更新了 2.1.61 和 2.1.62。

2026年2月12日智谱发布了GLM 5,最开始支持GLM Coding Max,后面逐步开放至GLM Coding Pro。过年期间,一直在带娃,没时间来体验。

依靠Superpowers Skills来生成Skills效果是真不错。有些人有小说梦,那么这次就用Superpowers来创建一个玄幻小说Skill,大家看看效果怎么样?当然,这个只是看看Superpowers写出来的Skill的效果,实际应用中需要更严谨。

Claude Code 最近挺火的,Skills 生态也丰富起来了。但在国内想用起来,确实得折腾一番。

年前,一位朋友找我帮忙做个App,用于工地围栏打卡。我问他:”现在工地不是有成熟的系统和设备吗?还去搞这个干啥?”他无奈地说:”成熟的东西贵啊,现在钱不好挣、也不好收。”我想了想,目前这行情,大家都不容易。便答应了下来。

快过年了,国内大厂们又开始整活了。

前几天群里满屏都是腾讯元宝的链接,大家疯狂转发;今天倒好,群聊又被阿里千问的口令刷屏了。